記者/馬麗昕

生成式AI大爆發,人類彈指之間畫出美麗的圖畫、生成出漂亮的行銷文案、精確地英文信件。AI成為民眾的工作助力,但是這些內容也能成為假訊息的溫床,甚至操弄選舉風向。因此,如何辨識AI假訊息,成為現今迫切需要解決的問題。

到底民眾如何辨識AI假訊息?AI專家、資管學者,以及新聞傳播學者認為「沒有唯一解方」,但是民眾都應了解AI,養成辨認「訊息來源」的媒體素養;而AI時代也將成為新聞媒體的亮光,新聞查證內容將更重要,也無可取代。

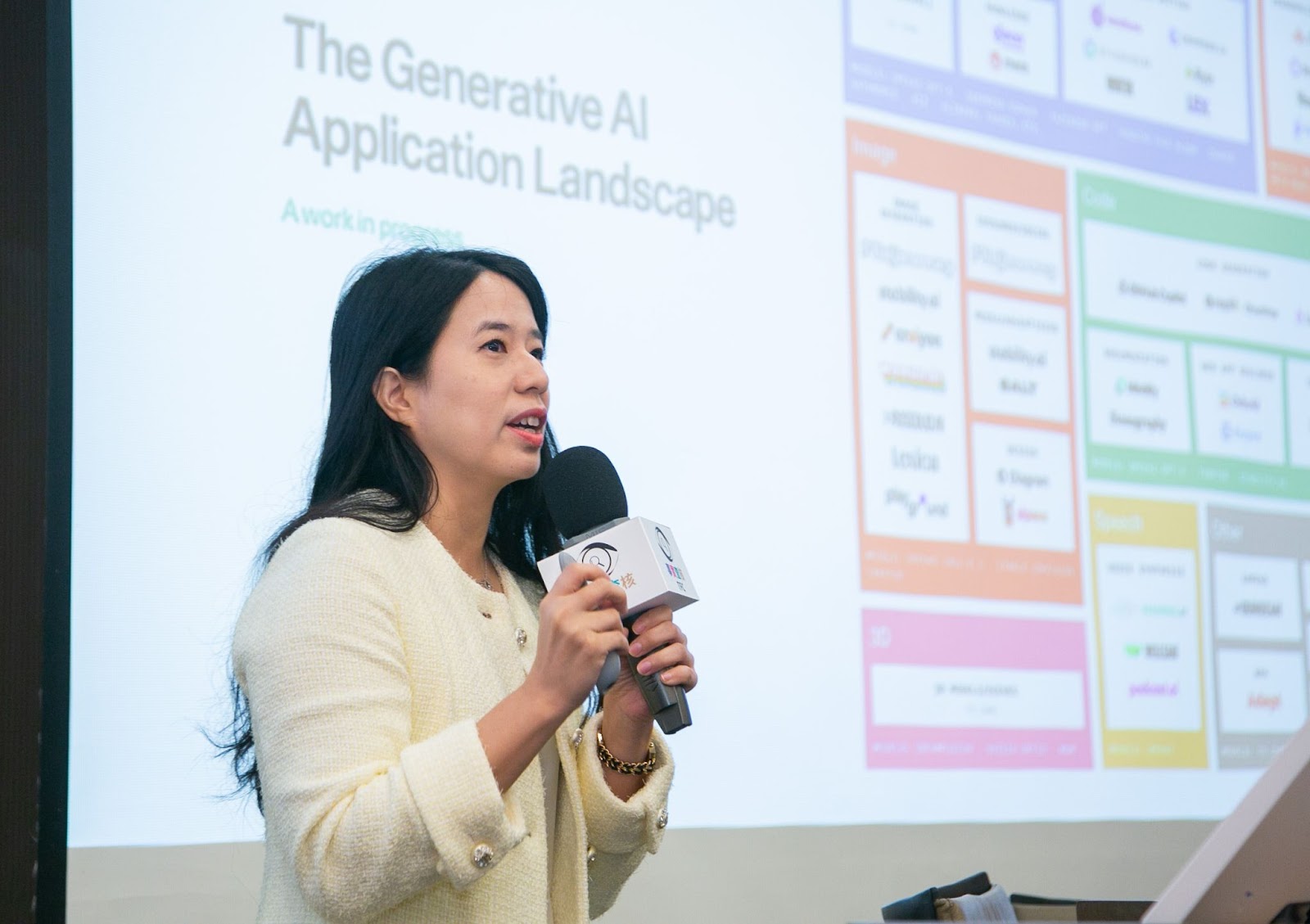

「2023調查報導與事實查核工作坊」7月29、30日於台北舉辦。首場講座是民眾最關注的「AI時代的真假挑戰」,邀請中央研究院人文社會科學研究中心研究員蔡宗翰、 政治大學傳播學院特聘教授林日璇、臺灣大學資訊管理學系副教授孔令傑,從各自的領域分享AI生成的最新發展,AI對於媒體是助力或是衝擊,以及AI時代民眾應該有的公民素養。

圖1:從左到右為臺灣大學資訊管理學系副教授孔令傑、中央研究院人文社會科學研究中心研究員蔡宗翰、 政治大學傳播學院特聘教授林日璇、論壇主持人卓越新聞獎基金會董事長蘇正平/攝影:林鼎皓

ChatGPT不是搜尋引擎 它能輕易生成假訊息

一張台北市府前民眾聚集抗議的照片,是真的還假的?資工專業、擅長文字AI,同時也推廣AI科普知識的中研院研究員蔡宗翰報告時秀出一張真假難辨的照片,引起在場民眾討論,有些人說是「假的」,也有人說的看起來「很真」。

看起來似假還真的照片,其實是蔡宗翰運用AI軟體創造出來的「假」圖,凸顯AI生成影像製作的容易、難以辨認的困境,很容易就能偽造時事、成為假訊息製作的溫床。

圖2:蔡宗翰投影片秀出一張「台北市府前民眾抗議」照片,在場民眾討論是否為真/馬麗昕攝影

AI工具在2022年開始引起全球注目,但擅長文字AI的蔡宗翰說,很多人不瞭解「ChatGPT」的生成原理。「大家可能會以為ChatGPT是聊天機器人;有些人當搜尋引擎,以為可以用ChatGP搜尋網路資料,但這些說法都是錯的。」

蔡宗翰解釋,ChatGPT是文字接龍程式,它會根據人給予的指令,文字接龍般生成訊息,一個字、一個字地生成出來。所以,它能化身智慧工具,有強大的運算能力、強力的語言能力。

但因其為文字接龍程式,ChatGPT能輕易產出「假訊息」。如給予適當的指令,ChatGPT就能生成「香蕉抗癌」的健康假訊息;疫情期間的「疫苗不實訊息」,也可以「技巧式」地利用ChatGPT快速生成。

圖3:中央研究院人文社會科學研究中心研究員蔡宗翰/攝影:林鼎皓

台大資管系副教授孔令傑也在報告時分享,如何引導出ChatGPT寫出「波菜和高麗菜一起吃有害身體健康」的假訊息,並且把「虛構內容」的註明拿除,更冠上XX醫師,讓訊息以假亂真。

從這些實例都可以證明,儘管有一定規範,但假訊息製作者都能輕易利用ChatGPT快速且大量地生產不實訊息。

使用ChatGPT心法:認識生成原理、辨認訊息來源、找到可信來源

當AI工具讓造假更簡單,民眾受騙的風險也會增加。孔令傑說,ChatGPT是文字接龍,但很多人把它當成搜尋引擎。他曾聽圖書館員分享,民眾拿著從ChatGPT問到的「書名」和「ISBN編號」到圖書館找書,但翻遍了圖書館,根本找不到民眾要找的書籍。原來,這些書籍從頭到尾都僅存在於ChatGPT的平行世界中。

孔令傑說,ChatGPT可以「一本正經地胡說八道」,也增加民眾的辨識難度。現在雖然有工具能猜測文字是否是AI生成,但只能高度懷疑,並沒有實質證據。

孔令傑說,因此,民眾首先應先了解ChatGPT的原理,並且回到訊息辨認的基本素養「訊息從哪裡來?」著手。如果是非具名發布的網路資訊,應對訊息存疑;如果是官方單位、新聞媒體,原則上較為可信。

他也鼓勵民眾,尤其是名人,應更謹慎且積極努力的發文,具名的發佈訊息,也應該附上可供查證的資料來源,建立自已的信譽。

圖4:台灣大學資訊管理學系副教授孔令傑/攝影:林鼎皓

面對難以辨認的AI生成文字訊息,政大傳播學院特聘教授林日璇在報告時說:「在AI生成內容爆發的時代,新聞媒體更重要,這也是新聞產業的亮光點,因為新聞做的就是具有事實查證的內容。」

林日璇說,民眾應該認知,ChatGPT提供的內容不一定都是正確的,它的定位應該是「協助整理、創意思考發想、事實基礎改寫」。而任何「事實陳述」都需要有可信來源,在這個資訊容易產製的時代,新聞產製過程中求證內容,提供可信的事實陳述更為重要,也是新聞業更為可貴之處。

AI圖像、AI聲音、AI電影 人類進入虛擬真實的時代

長期研究元宇宙、虛擬真實的林日璇說「我們正進入虛擬真實的時代」。早在過去,美白濾鏡APP、美妝品牌試妝等早已將AI技術用於商業目的。但從2022年開始,AI生成圖像、聲音等內容 (AIGC)成為全球趨勢,每個人都可以利用AI圖像生成工具製作出精美圖像、聲音,甚至是電影。

她也發現,這些工具愈來愈進步,生成出的圖像也愈來愈真實。另一款工具DALLE-2更可以無限延伸創意,讓一張照片無限擴充出本不存在的背景。

圖5:AI工具生成出名人專輯封面的「擴充背景」/來源:創作者Ruby Nian

除了AI生成圖像,AI生成聲音、文字生成影片等,都是AI生成趨勢,更能製作AI電影,美劇《黑鏡》的世界將在不久將來發生。林日璇舉例,像是利用「Murf AI」工具,使用經授權的名人、權威聲音,創造出大量聲音口白;此外,Google「Imagen video 」工具,只要有文字指令就能生成出影片。

林日璇說,台灣新聞界也有利用AI協助新聞產製的案例,像是《民視》製作出台灣第一個AI主播;《三立新聞》也使用AI製造出記者親臨「戰場」的現場效果,這也挑戰了新聞倫理的界線。

面對爆發式的AI生成內容,林日璇認為應從政策面切入,應規定AI影像要「加註說明」,直接告訴民眾這不是真實影像;業者也應該有自律條款,明確標示使用AI輔助。

圖6:政治大學傳播學院特聘教授林日璇/攝影:林鼎皓

AI影像恐成選舉操弄工具 民眾應學會「辨認」訊息來源!

這些愈來愈「真實」的影像,也可能成為假訊息的製造商,更可能在選舉期間,操弄風向、影響選舉結果。

今年5月,一張五角大廈爆炸的照片,引起社群瘋傳,但其實這是由AI生成,也並未有爆炸的事情發生。根據查核中心5月報導,這張「五角大廈」AI照片真假難辨,5月22日首在社群流傳時甚至造成美股短暫下挫。《彭博社》更指出這是AI生成圖片影響股市的首起案例。

圖7:推特帳號「BloombergFeed」發布五角大廈發生爆炸的AI照片。

如何減少選舉期間AI生成假訊息的影響,與談學者提供民眾解方。

蔡宗翰認為,AI生成內容不是問題,問題在於利用AI操弄選舉風向,因此,要用「以AI防AI」,大家應該關注是誰發出的AI假訊息,學界也應該用AI工具偵測假訊息發文的模式。

但回到個人可以怎麼做?孔令傑強調,社群上來路不明的訊息民眾應一律存疑。

孔令傑說,假設在選舉投票前,民眾要了解候選人對特定政策的態度,應該要選擇可信的來源,例如是可受公評的新聞媒體、候選人自己的臉書等。但若是不知道來源的人發佈,就不應該相信。

孔令傑舉例,民眾若在社群收到不確定來源的圖像、文字,應養成基本求證的好習慣,像是從候選人的官方臉書、新聞媒體求證是否為真。

林日璇則說,社群上愈多真假難辯的訊息,民眾應該要「後退一步」,斟酌選擇要不要看社群的東西,更積極性地接觸可信內容,如選舉公報。

卓越新聞獎基金會、台灣事實查核教育基金會和優質新聞發展協會共同舉辦「2023調查報導與事實查核工作坊」7月29、30日於台北舉辦。工作坊內容聚焦在AI時代的造假訊息、事實查核挑戰與社群平台的假訊息漩渦。